핵심 요약 [TL;DR] :

- 온프레미스 LLM 도입 시 인프라 대비 데이터·보안·개발 환경 미결합으로 인한 활용 한계 존재

- ModelHub, 모델 생애주기 전반을 통합 관리하는 온프레미스 AI 운영 환경으로 설계

- 웹 기반 모델 배포·버전 관리 및 관제 기능을 통한 모델 자산화와 운영 효율성 확보

- 데이터 거버넌스 및 전처리·파인튜닝 파이프라인 기반 고품질 데이터셋 구축과 모델 최적화 체계 지원

- 인프라 가시성·운영 감사·사용 패턴 분석을 통한 리소스 최적화 및 데이터 기반 운영 체계 강화

- LLM 가드레일 및 실시간 필터링 기반 보안·안정성 확보와 지속적 피드백 루프 구축

많은 기업이 보안과 데이터 주권을 위해 온프레미스(On-premise) 환경의 로컬 LLM 도입을 검토하지만, 실제 구축 과정에서는 높은 진입장벽에 직면합니다. 서버와 모델이라는 ‘엔진’을 갖추더라도 이를 실무에 적용하기 위한 데이터 파이프라인, 보안 필터, 그리고 효율적인 앱 개발 환경이 유기적으로 결합되지 않으면 막대한 인프라 비용만큼의 가치를 이끌어내기 어렵기 때문입니다.

ModelHub는 온프레미스 환경에서 AI 모델의 생애주기를 통합 관리하여, 인프라의 잠재력을 극대화하는 최적의 운영 환경을 제공합니다.

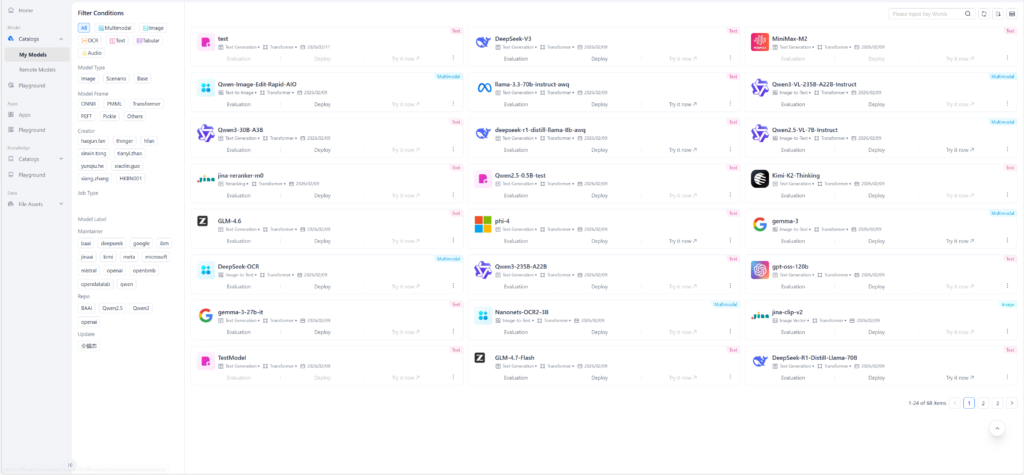

1. 웹 기반의 모델 배포 및 자산화 관리

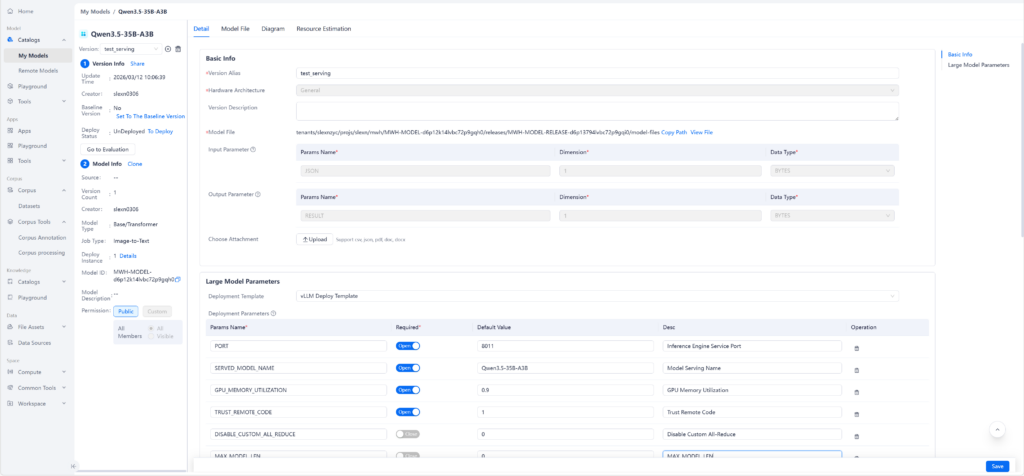

모델 카드를 통한 체계적인 자산화: 등록된 모든 모델은 규격화된 ‘모델 카드’로 관리됩니다. V1, V2 등 자동 버전 관리를 통해 모델의 이력을 투명하게 추적하며, 특정 시점의 우수한 모델을 즉시 호출하거나 기존 모델을 기반으로 새로운 브랜치를 파생시키는 등 유연한 자산 관리가 가능합니다.

인프라 설정의 자동화: 복잡한 터미널 명령어나 수동 환경 설정 없이도 웹 UI에서 서비스 이름, 할당 리소스(GPU/CPU), 포트 등 핵심 파라미터 설정만으로 API 서비스를 즉시 배포할 수 있습니다. 이는 배포 과정에서의 휴먼 에러를 방지하고 운영 속도를 획기적으로 개선합니다.

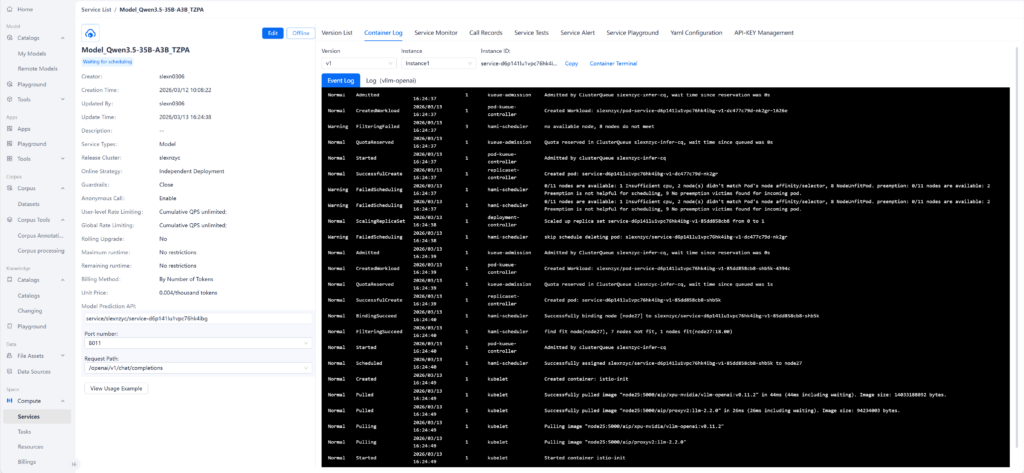

통합 관제 및 안정성 검증: 별도의 외부 도구 없이 웹 환경에서 서비스 연결 상태를 즉각 테스트할 수 있습니다. 실시간 컨테이너 로그 분석과 노드별 리소스 점유율(VRAM, Memory) 모니터링 기능을 통합 제공하여, 배포 직후의 안정성 검증부터 상시 운영까지 한 곳에서 제어합니다.

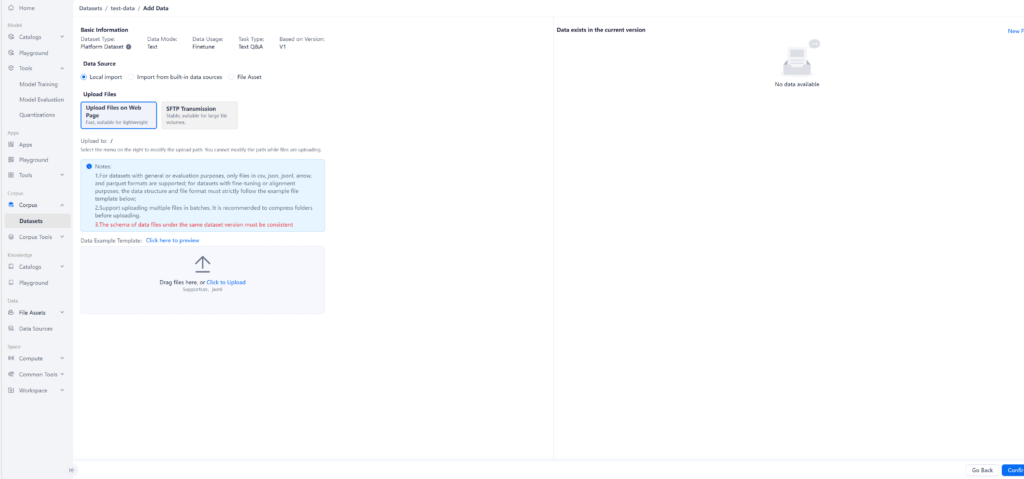

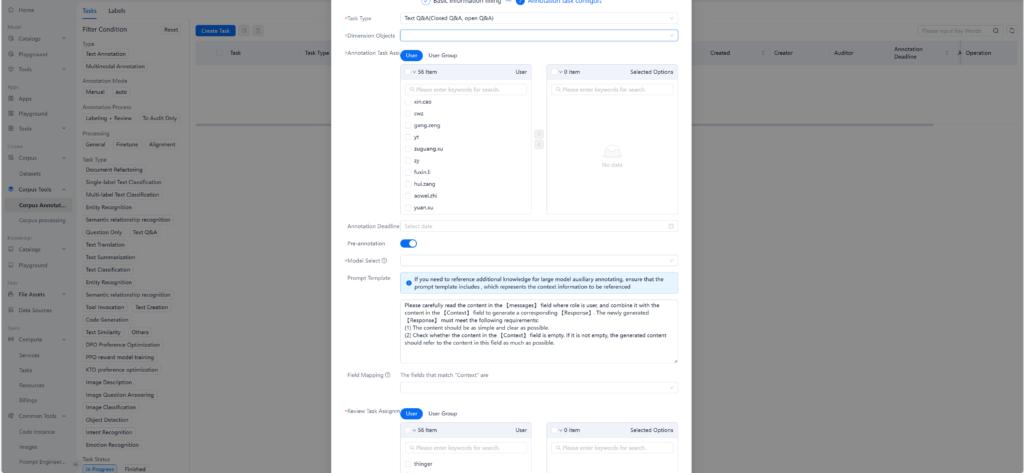

2. 데이터 거버넌스와 고도화된 파인튜닝 파이프라인

데이터 자산화의 기반, 스마트 코퍼스(Corpus) 관리: 로컬 스토리지는 Object Storage 등 사내의 다양한 데이터 소스를 직접 연결하여 통합 관리합니다. 데이터셋 업로드 시 스키마 유효성을 자동으로 검증해 학습 오류를 미연에 방지하며, 데이터셋 역시 버전별로 관리하여 모델 성능 개선의 근거로 활용합니다.

워크플로우 기반의 데이터 전처리: 정제, 중복 제거, PII(개인식별정보) 비식별화 등 50여 개의 전처리 연산자를 시각적 파이프라인으로 구성할 수 있습니다. 특히 비정형 문서에서 QA(질의응답) 쌍을 자동 추출 및 보강하는 기능을 통해 학습용 고품질 데이터셋 구축 비용을 대폭 절감합니다.

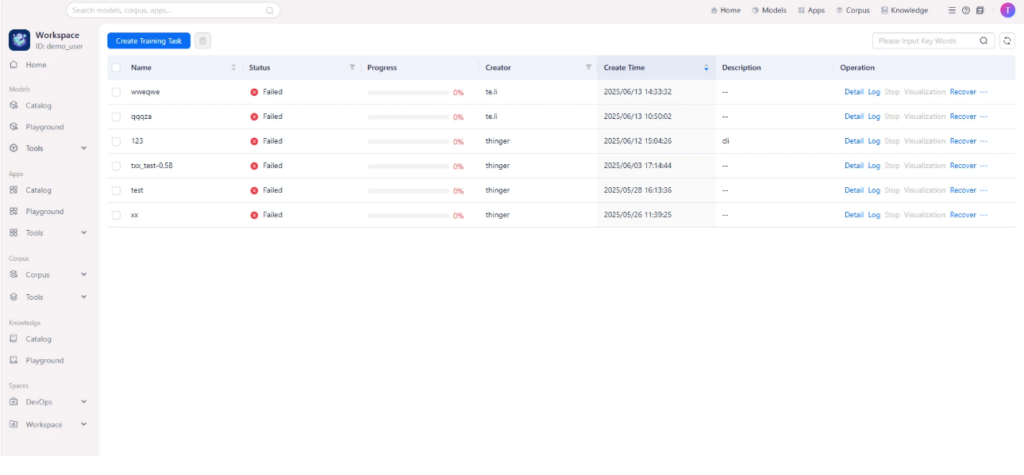

효율적인 모델 최적화(Fine-tuning): LoRA(Low-Rank Adaptation)와 Full Fine-tuning을 모두 지원하며, 웹 인터페이스를 통해 학습 파라미터를 정교하게 제어할 수 있습니다. TensorBoard와의 연동을 통한 실시간 학습 곡선 모니터링은 물론, 장애 발생 시 체크포인트 기반의 자동 복구 기능을 지원해 학습 안정성을 보장합니다.

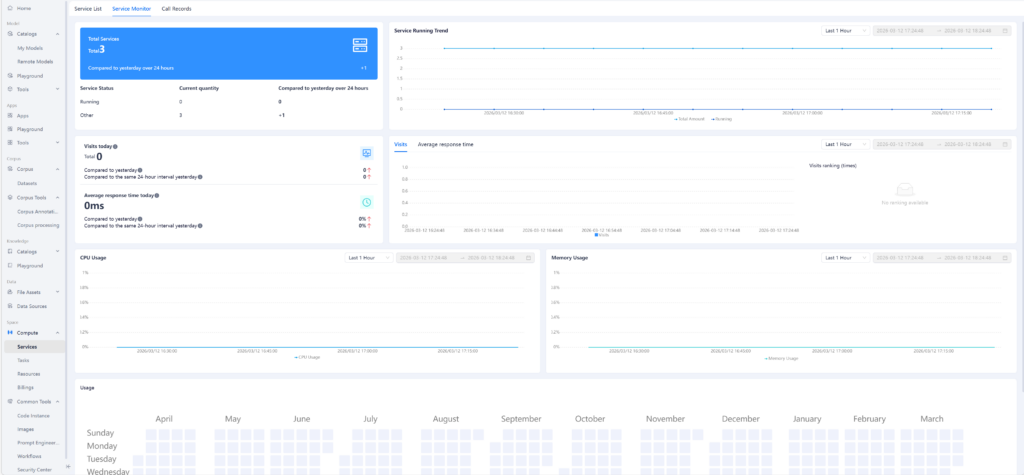

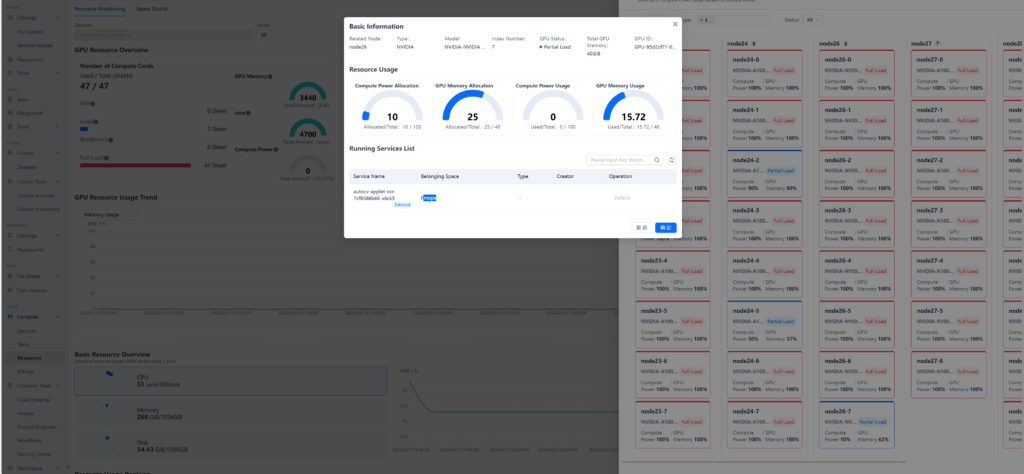

3. 실시간 인프라 가시성 및 운영 감사

서비스 헬스 체크 및 수요 분석: 구동 중인 서비스의 상태(Running, Pending, Failed 등)를 대시보드로 실시간 시각화합니다. 특히 시간대별 호출량 히트맵(Heatmap)을 통해 사용 패턴을 분석함으로써, 트래픽 집중 시간대에 맞춘 전략적 리소스 배분과 최적화가 가능해집니다.

정밀 하드웨어 모니터링: 개별 GPU의 연산량과 비디오 메모리(VRAM) 사용량을 노드 단위로 정밀하게 추적합니다. 특정 장비의 과부하를 즉각 감지하고, 할당된 쿼터(Quota) 대비 실제 사용량을 비교 분석하여 인프라 확장 시점을 데이터 기반으로 결정할 수 있습니다.

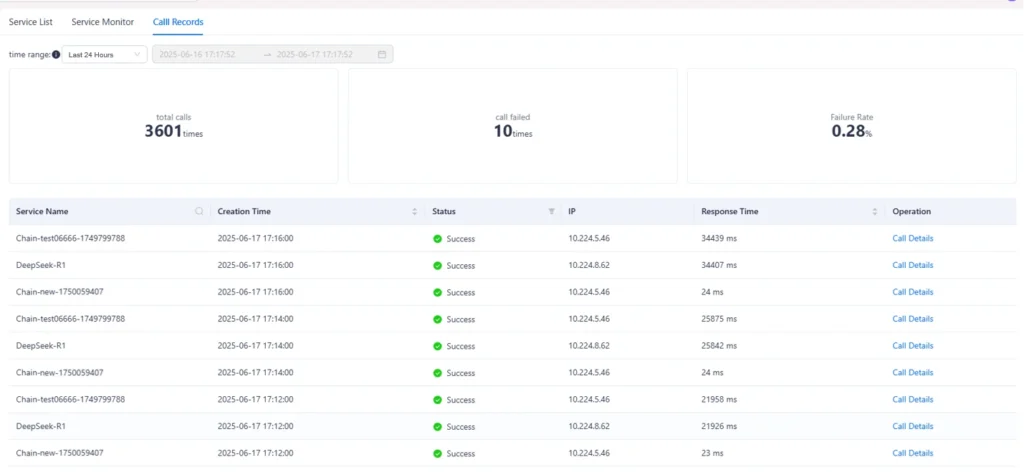

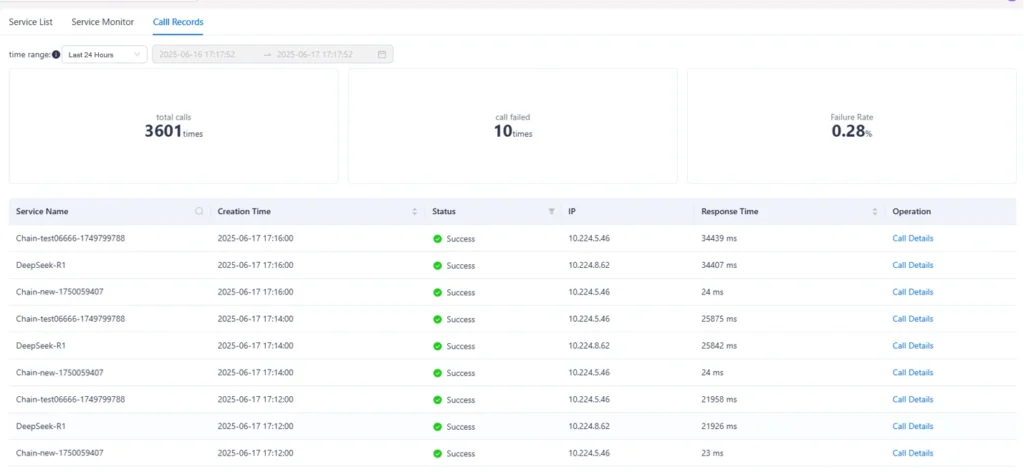

운영 투명성 및 데이터 피드백 루프: 모든 API 호출은 요청 IP, 처리 시간, 성공 여부 등 상세 로그로 기록되어 운영 감사(Audit) 자료로 활용됩니다. 누적된 호출 데이터와 실패율 분석 결과는 다시 모델 재학습의 피드백으로 연결되어, 실제 사용자 환경에 최적화된 모델로 고도화되는 선순환 구조를 만듭니다.

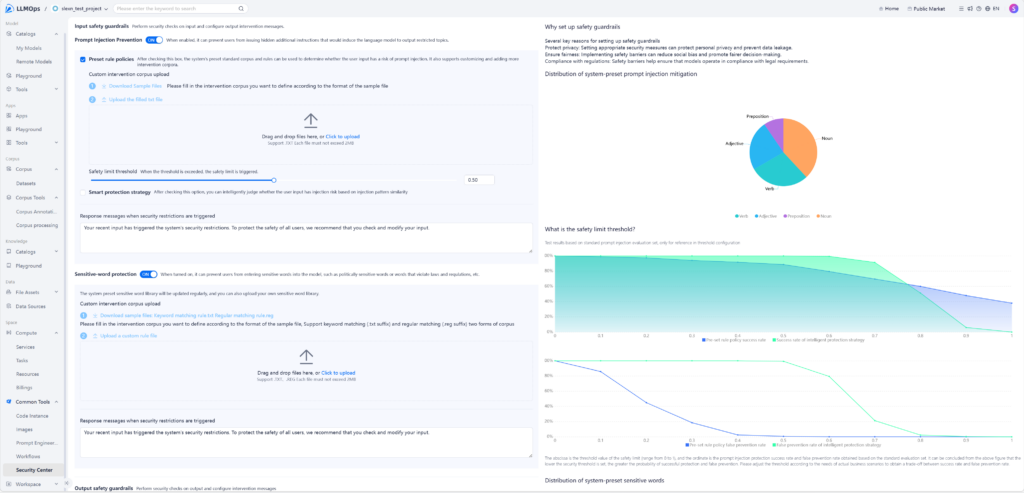

4. LLM 세이프티 가드레일과 실시간 방어 체계

프롬프트 인젝션 및 유출 방지: 외부 사용자가 모델을 속여 제한된 주제를 논의하게 하거나, 내부 지시문(System Prompt)을 탈취하려는 시도를 지능적으로 감지하고 차단합니다. 모델의 고유한 정체성을 유지하고 악의적인 공격으로부터 시스템을 보호하는 핵심 방어 기제입니다.

민감 정보 및 유해 콘텐츠 필터링: 개인정보(PII) 유출 방지를 위한 실시간 비식별화 처리는 물론, 정치·종교 등 민감한 주제나 공격적인 언어 사용을 실시간으로 스캐닝합니다.

투명한 호출 감사와 피드백 루프: 모든 API 호출 데이터는 성공/실패 여부와 처리 시간을 포함하여 리스트 형태로 기록됩니다. 이 누적된 데이터는 실제 사용자 패턴을 분석하고 모델을 지속적으로 고도화하는 데이터 피드백 루프의 핵심 자산으로 활용됩니다.

ModelHub는 복잡한 AI 인프라 운영의 복잡성을 제거하고, 기업이 오직 ‘AI를 통한 비즈니스 가치 창출’에만 집중할 수 있는 엔터프라이즈급 운영 환경을 제안합니다.